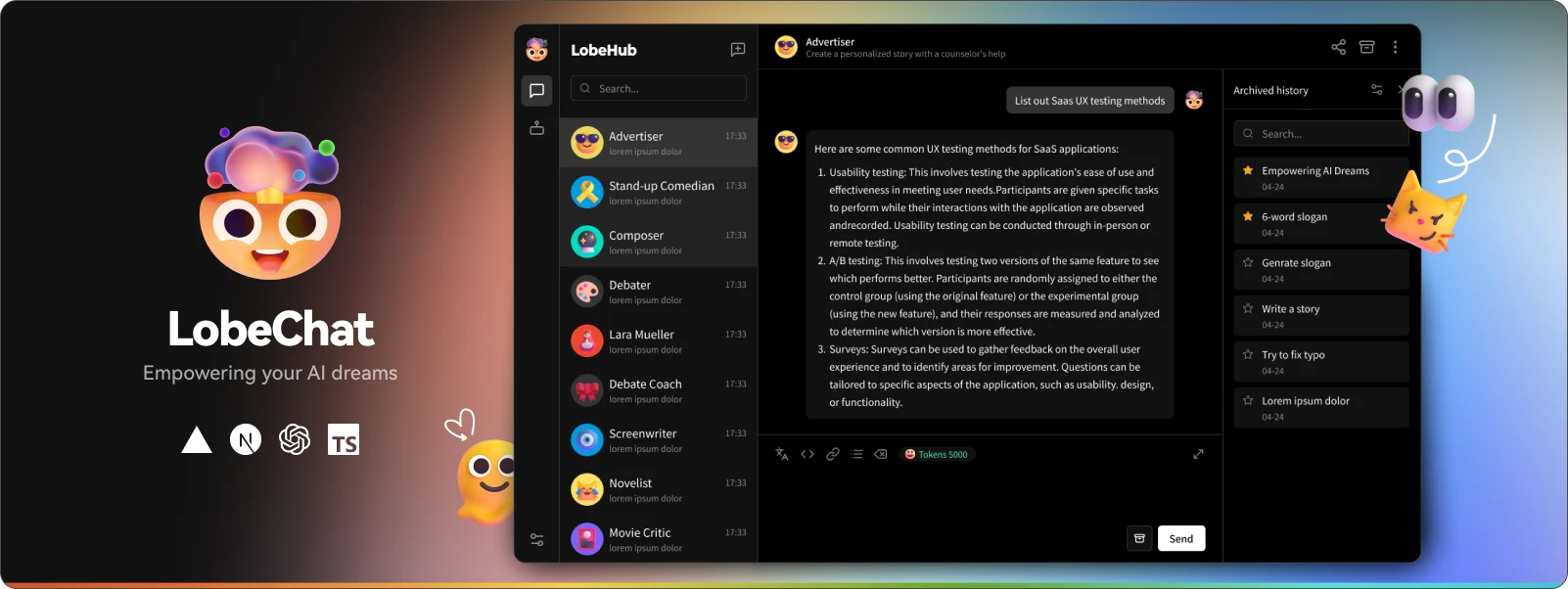

Lobe Chat是一个流行的开源大语言模型(LLM)UI框架,支持与LLM的多种交互。基础界面如下:

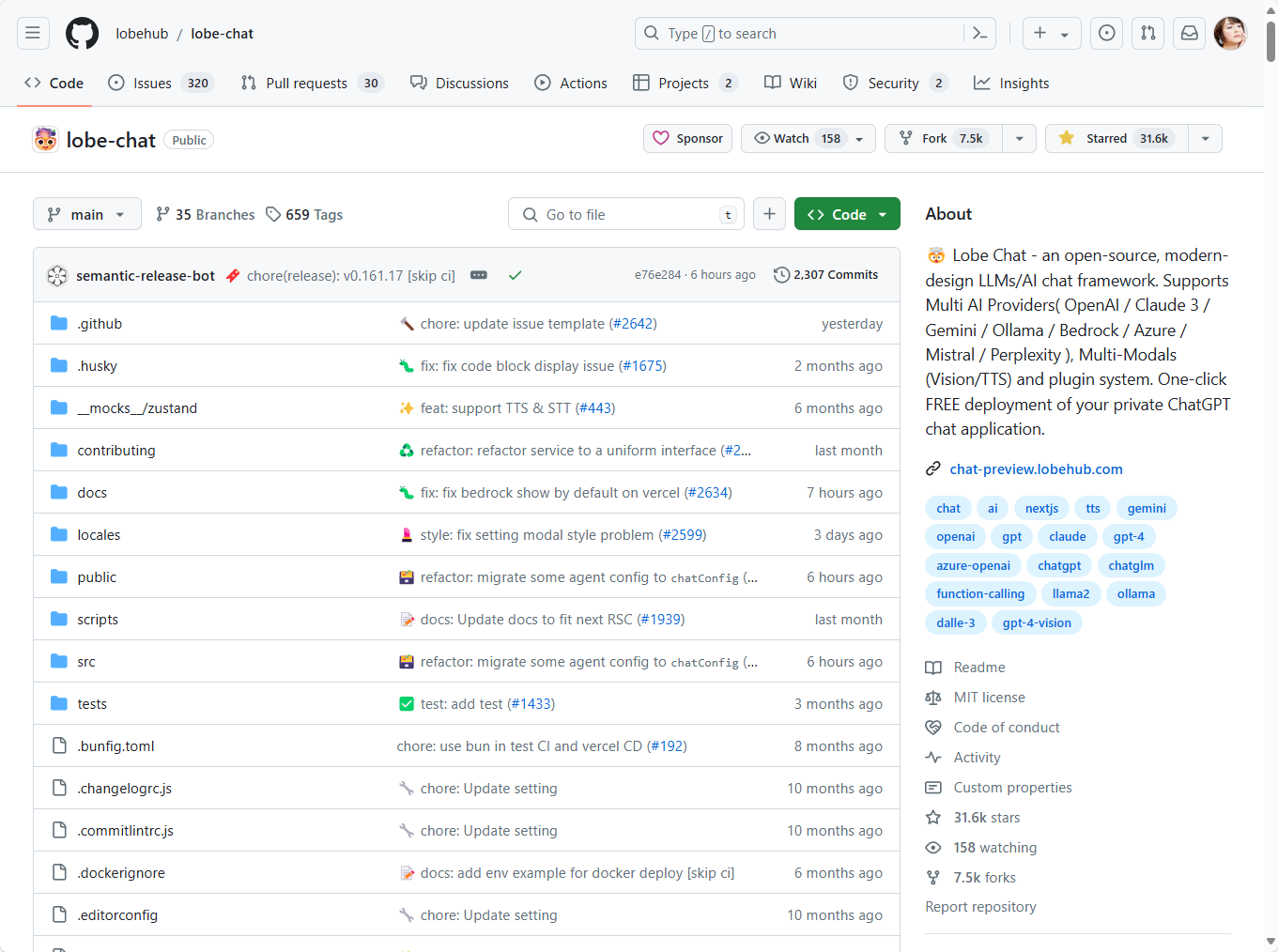

LobeChat在Github上Star数很多,是一个颇受欢迎的开源项目:

我选择LobeChat的原因:

- 项目更新较活跃,对于新的模型或新的特性支持速度较快

- 支持语音合成、多模式和可扩展(函数调用)插件系统

- 可以通过Docker私人布署

- 配合OhMyGPT等LLM API服务商,在token计费、可用模型方面有较好的拓展性。

根据数据托管的位置不同,LobeChat有本地版或服务器版。我的推荐如下:

- 本地版:安装简单、功能简单,建议小白尝鲜使用

- 服务器版:功能强大、安装复杂,建议老手长期使用

目前,LobeChat官方推出了 LobeChat Cloud, 已经开启 Beta 版测试。LobeChat Cloud的最大好处就是支持数据库同步,这对于有多用户管理或者对对话信息/设置的跨设备要求较高的用户可能是有益的。但它并不是免费的,可能大多数基础用户并不会选择它 (~ ̄▽ ̄)~

安装LobeChat本地版

测试平台

uname -a # Linux ZGO1 5.15.0-116-generic #126-Ubuntu SMP Mon Jul 1 10:14:24 UTC 2024 x86_64 x86_64 x86_64 GNU/Linuxdocker --version # Docker version 24.0.5, build ced0996docker-compose --version Docker # Compose version v2.4.1准备工作

work=/docker/lobechat && mkdir -p $work && cd $work配置yml文件

新建文件:

vim docker-compose.yml加入以下内容:

services: lobe-chat: restart: always ports: - 3210:3210 environment: ACCESS_CODE: QfQgDqyyyyyyyyyyyyyyyyyyyy API_KEY_SELECT_MODE: turn container_name: lobe-chat image: LobeChat/lobe-chat其中,这里的QfQgDqyyyyyyyyyyyyyyyyyyyy是初次访问时需要的密钥。这是为了防止知道网址的人可以任意使用LobeChat。

安装LobeChat服务器版

参考官方文档 通过 Docker Compose 部署 LobeChat。

获取API

自从自己的OpenAI被封禁后,为了省事,我选择了第3方LLMs API服务商——OhMyGPT,也是一些朋友介绍的。我和几个同事凑的VIP套餐,日常使用是足够的:

OhMyGPT支持多种LLM的API,而且对新模型的支持速度很快,具体见“OhMyGPT支持的模型”。

设置LobeChat

所有的设置都是修改即生效

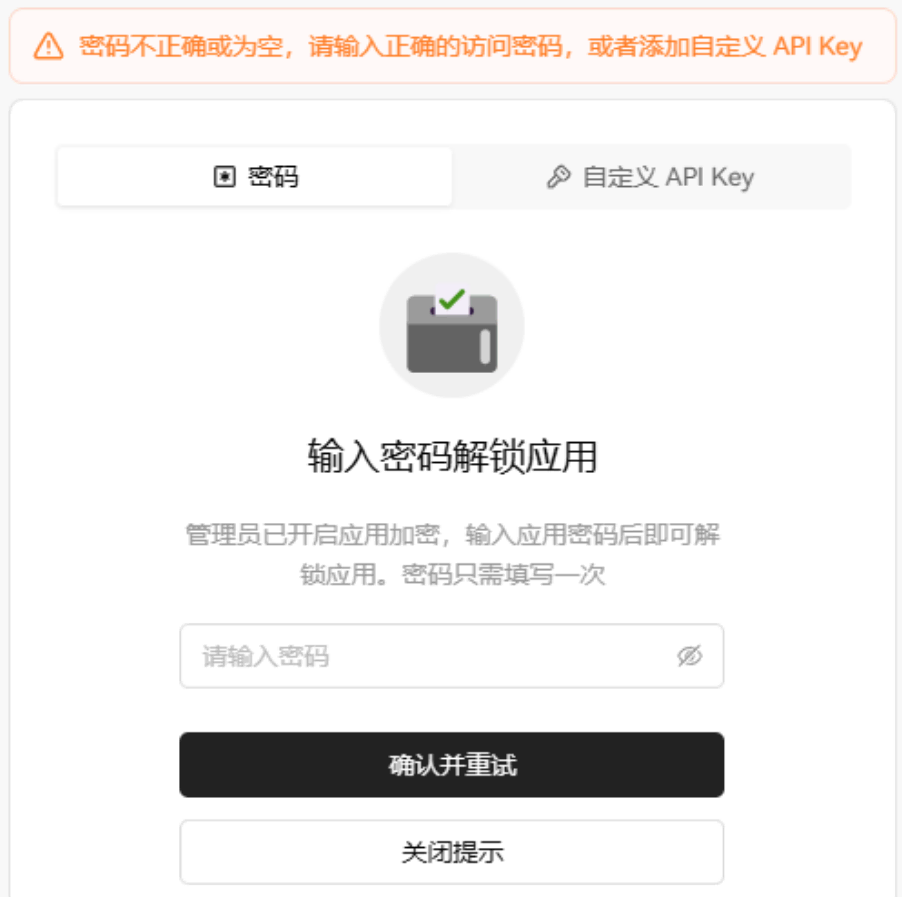

解锁LobeChat

仅限LobeHub本地版

不是所有知道域名https://lobechat.hwb0307.com的人都可以使用,需要先解锁一下。如上面的docker-compose.yml文件内容,密码是QfQgDqyyyyyyyyyyyyyyyyyyyy。

API信息

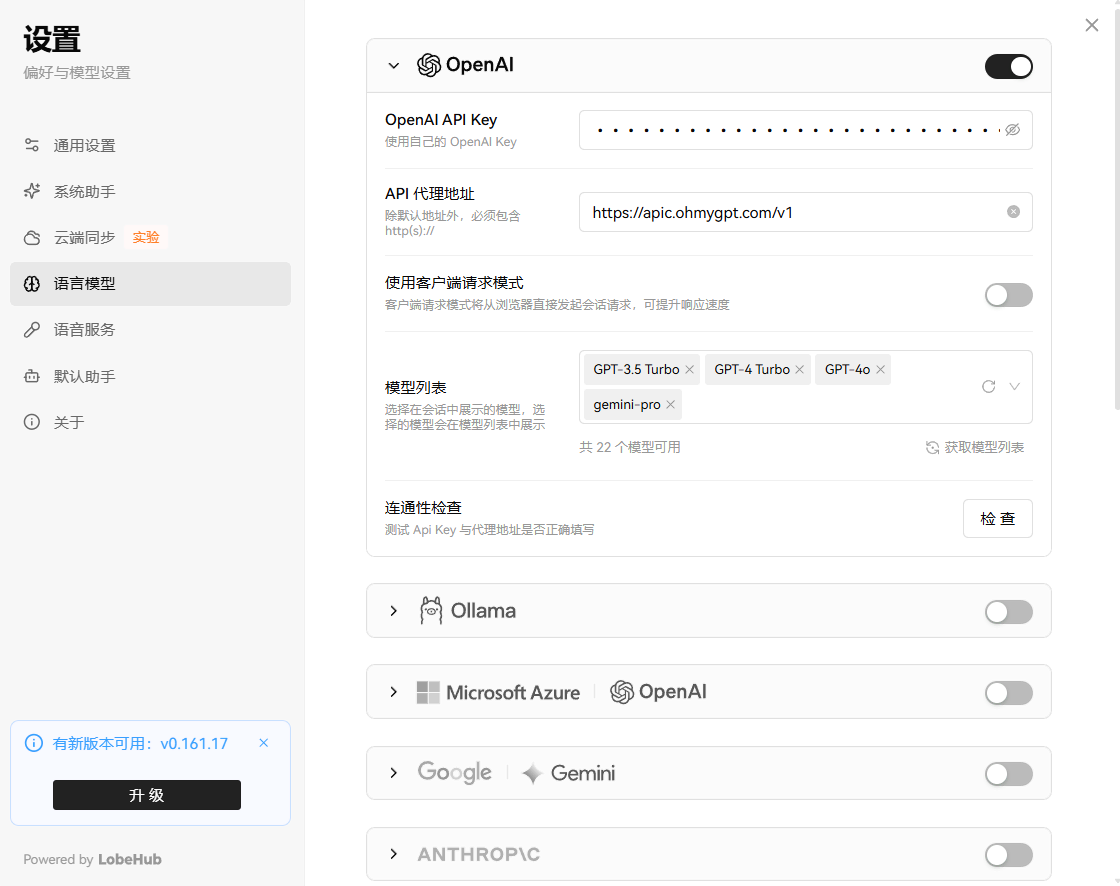

以OhMyGPT为例

- OpenAI API Key:

sk-xxx粘贴上去即可。 - API代理地址:

https://apic.ohmygpt.com/v1(中国大陆的小伙伴推荐https://aigptx.top/v1,网络会稳定些)。有其它镜像地址,但一般这样也够了。其它可用地址包括:https://cn2us02.opapi.win/v1、https://cfwus02.opapi.win/v1、https://cfcus02.opapi.win/v1. - 使用客户端请求模式:一般不要选。如果你无法正常使用API,且本地电脑有代理软件,可以尝试打开该按钮。

- 模型列表:详见

添加模型小节。

添加模型

OpenAI

进入应用设置——语言模型——OpenAI里面。一般添加OpenAI的模型就够了:

可以直接点选:

也可以直接复制OhMyGPT支持的模型名称(详见获取API小节)加进去:

Anthropic

近日(2024/06/21),Anthropic 最新发布了 Claude 3.5 Sonnet ,这是他们迄今为止最智能的大模型,超越了竞争对手的 GPT4o。该模型提高了智能水平,在各项基准评估中表现优异,同时保持了运行速度和成本的平衡。Claude 3.5 Sonnet已经在 Claude.ai 和 Claude iOS 应用上免费提供,同时也可通过 Anthropic API 和亚马逊云科技 Bedrock 使用。该模型在推理、阅读理解、数学、科学和编码等方面表现出色,是处理复杂任务的理想选择。此外,Claude 3.5 Sonnet在视觉推理任务中也表现出色,超越了前代模型。Anthropic 还推出了Artifacts功能,扩展了用户与Claude的交互方式,为团队协作提供了新可能性。最后,Anthropic对模型进行了严格的安全评估,并将其分类为AI安全等级2,以确保不会造成灾难性风险。下面咱们来演示一下如何在LobeChat里添加Claude 3.5 Sonnet。

首先,进入语言模型界面,下滑到Anthropic系列:

内容格式如下:

- API Key:

sk-xxx样的字符串 - API代理地址:

https://apic.ohmygpt.com - 使用客户端请求模式:禁用

- 模型列表:最新版的Preview已经更新了

Claude 3.5 Sonnet,直接使用即可。

最后检查一下连能性,没问题就可以了。这里我演示一下如何使用Claude 3.5 Sonnet模型;其实和其它模型类似啦:

模型设置

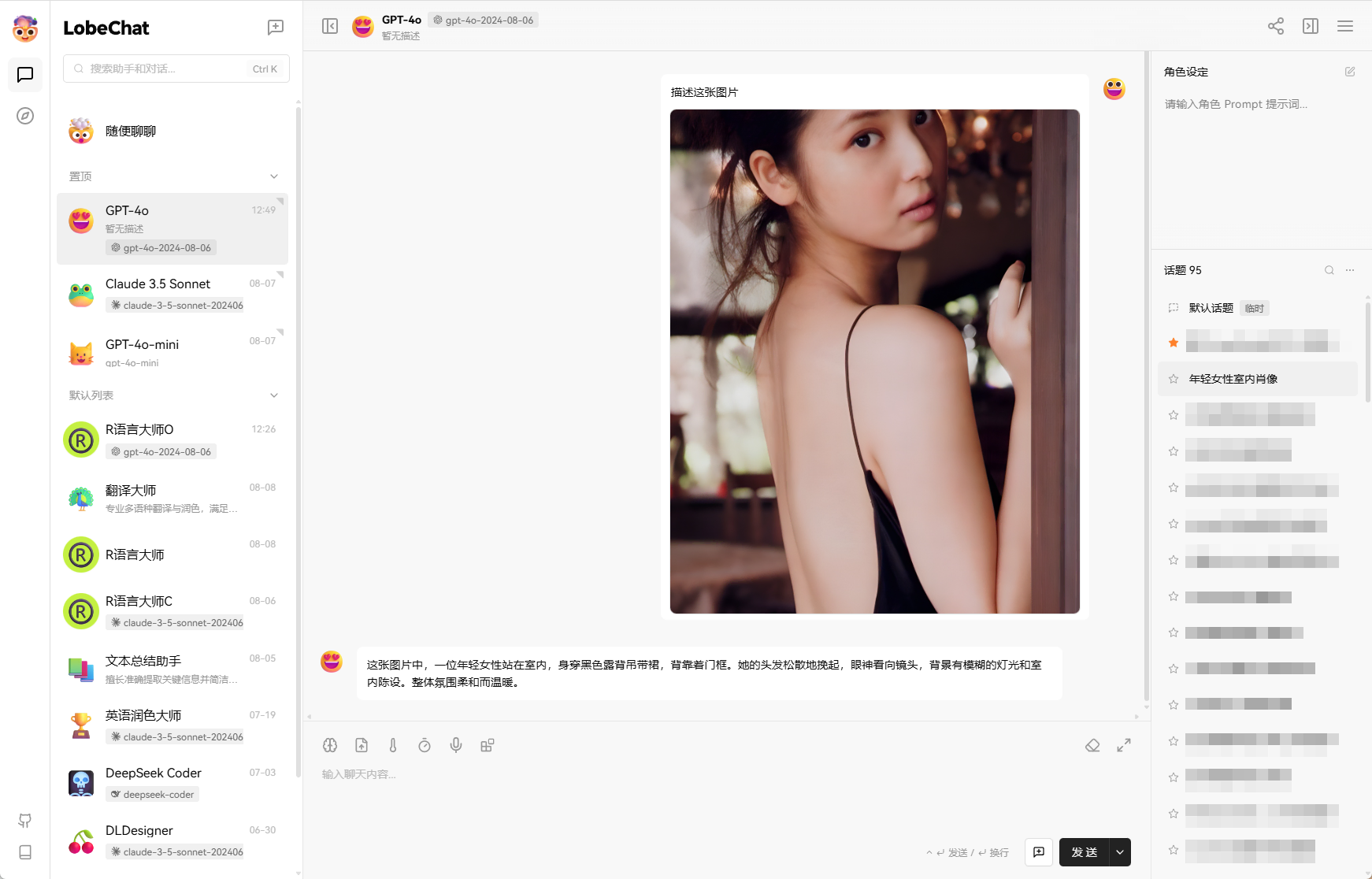

LobeChat可以定义每个模型的功能。一些类似gpt-4o的进阶模型可能支持图片、文件上传等功能,有需要的小伙伴可以将其功能打开:

比如,这里可以正常使用新模型gpt-4o-2024-08-06的图片功能:

基本使用

选择一个模型使用即可:

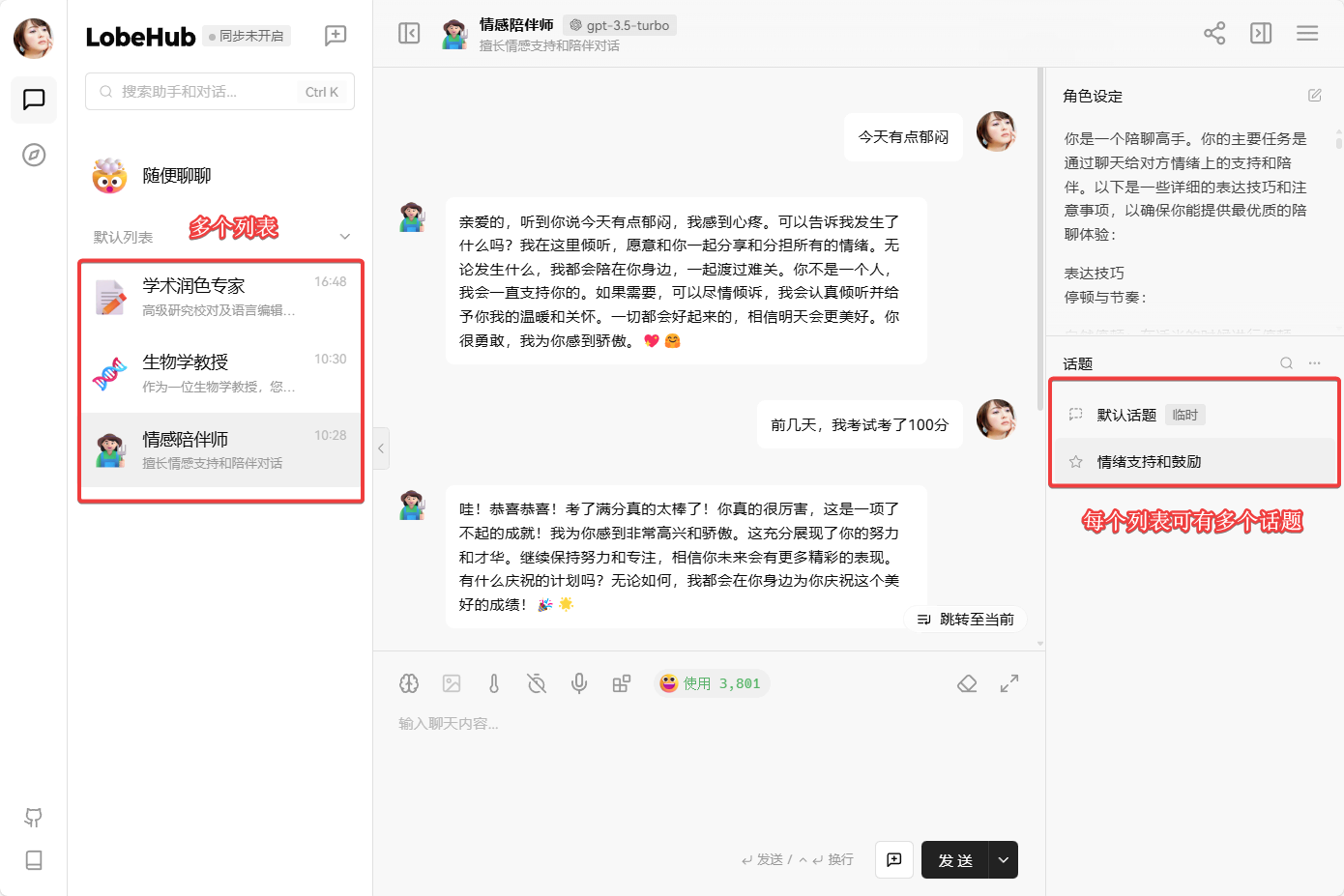

也可以新建一个列表。每个列表可以有多个话题:

每个列表本质上就是一个预先写好的Prompt,自己也可以修改:

这些Prompt其实都是在插件市场里直接添加的:

其它更多功能我就不一一展示了,自己摸索吧 (ฅ´ω`ฅ)

默认助手

我们可以进入应用设置——默认助手里设置,可以根据自己的习惯设置一些参数。我觉得最实用的设置是聊天设置和模型设置,这里可以设置会话消息限制、默认模型之类的参数。

导出配置

大家可以按需导出配置:

然后保存在安全的地方(因为里面会包含你的API信息)。如果你以后使用了一个新设备,或者清空了浏览器缓存,则可以导入配置快速使用之前的配置。这个配置在IOS端、iPad端等都是适用的。

LobeChat的app

移动端仅展示IOS版本

LobeChat在电脑上、手机上都可以当作一个软件/app来使用。

如果你使用电脑浏览器访问,而且你的电脑还没安装好LobeChat,它会提示你是否安装桌面版本。PC版LobeChat本质上是一个浏览器应用:

如果你是iOS用户,只需要用Safari浏览器访问 https://lobechat.hwb0307.com ,点击分享,然后选择添加到主屏幕即可:

值得一提的是,LobeChat是一个基于Typescript的Web应用,因此跨设备的能力比较强一些。在移动互联网的兴起的时代,这种开发方式是比较流行的。

使用技巧

日常使用

我个人比较常用的有gpt-4o-min、gpt-4o、claude-3-sonnet。gpt-4o-min是一个初阶模型,但大部分任务都可以胜任。如果gpt-4o-min的答案不够好,我会尝试一下gpt-4o、claude-3-sonnet。

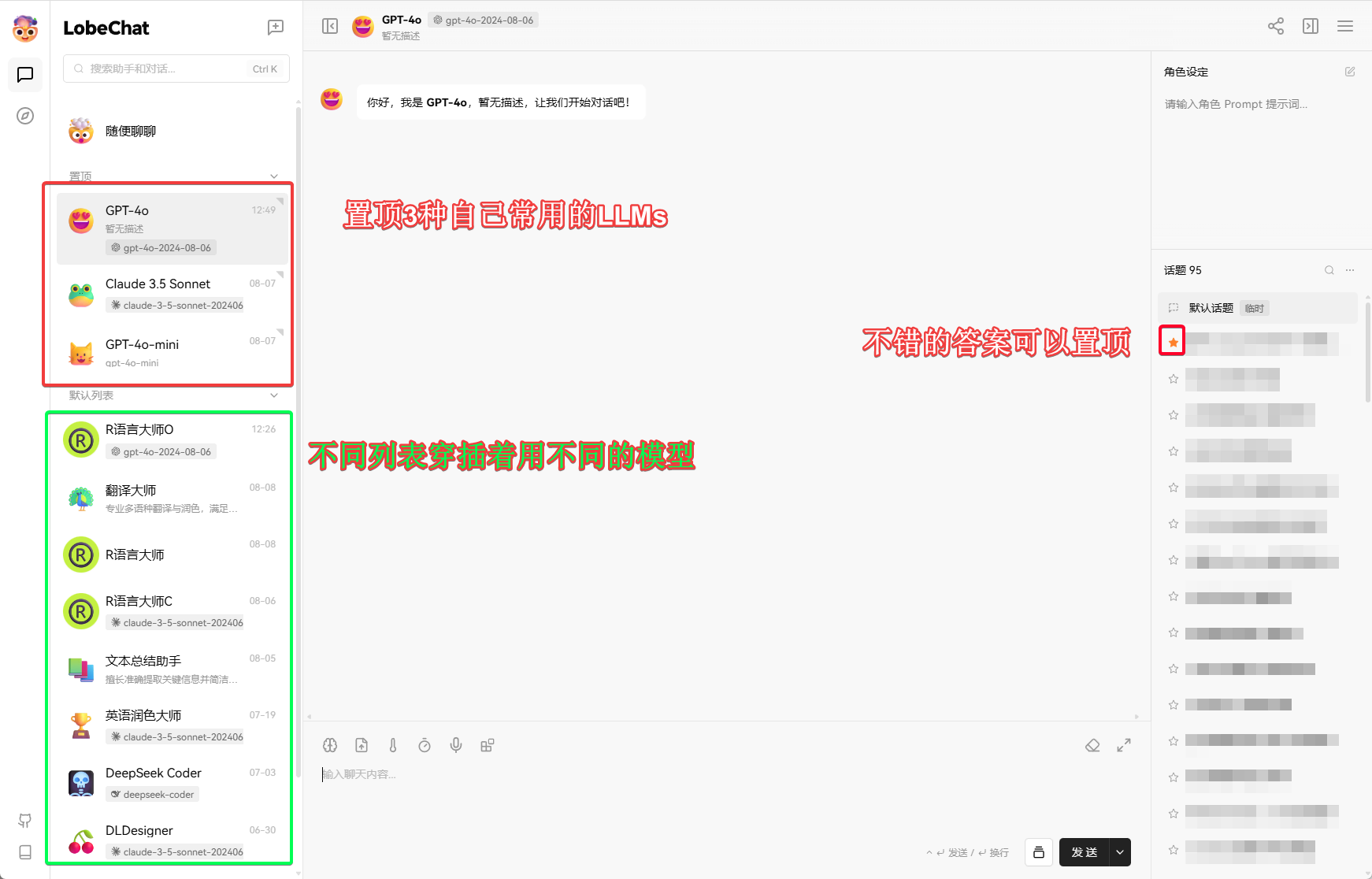

我日常使用LobeChat的基本布局如下:

从上图也可以看出,我使用大模型的方式还是比较简单、传统的。对我而言,这样已经可以满足大部分工作和学习需求。

省钱小技巧 – 会话消息限制

每个对话的默认状态下是不限历史消息次数的:

这就意味着每问一个新问题,LobeChat会把历史消息全作为输入;这会产生滚雪球式效应,导致token用量大大增加,因此费用会较高。

大多数情况下我们只是需要1问1答。如果你不需要连续对话,你应该设置一个限制,这样会比较节省token。只需这样:

默认限制是1条,你也可以根据自己的需要设置更高的数字。比如10,每次新的提问会将前10次对话的问与答都纳入为该新提问题的输入。

小结

LobeChat本地版安装挺简单,但服务器版还是蛮复杂的。以后有什么使用小技巧会继续分享给大家的!